IA Quantique - Partie 3 - Le soulèvement des IA

Précédemment, dans l’IA Quantique, on a vu que l’informatique quantique serait en principe capable d’accroître sensiblement la vitesse d’exécution de certains algorithmes de Machine Learning. Cela est dû au fait que certains phénomènes siégeant au coeur de tels ordinateurs (superposition des états, intrication des qubits, décohérence des états superposés, réduction brutale du paquet d’ondes) permettent de paralléliser les calculs en stockant plusieurs informations (superposées) avec une même particule. En accélérant considérablement certains traitements algorithmiques, on comprend que la quantique permettra aux IA de résoudre de nouveaux problèmes. Certains vont plus loin encore et y voient même un potentiel pour rendre un cerveau artificiel aussi performant que celui des humains, capable notamment d’intégrer des concepts abstraits comme la conscience et les sentiments. La question qui se pose alors est de savoir si l’IA quantique serait plus susceptible de devenir une “IA forte”…

Précédemment, dans l’IA Quantique, on a vu que l’informatique quantique serait en principe capable d’accroître sensiblement la vitesse d’exécution de certains algorithmes de Machine Learning. Cela est dû au fait que certains phénomènes siégeant au coeur de tels ordinateurs (superposition des états, intrication des qubits, décohérence des états superposés, réduction brutale du paquet d’ondes) permettent de paralléliser les calculs en stockant plusieurs informations (superposées) avec une même particule. En accélérant considérablement certains traitements algorithmiques, on comprend que la quantique permettra aux IA de résoudre de nouveaux problèmes. Certains vont plus loin encore et y voient même un potentiel pour rendre un cerveau artificiel aussi performant que celui des humains, capable notamment d’intégrer des concepts abstraits comme la conscience et les sentiments. La question qui se pose alors est de savoir si l’IA quantique serait plus susceptible de devenir une “IA forte”…Déjà, qu’est-ce que l’intelligence humaine ?

Avant de regarder les complémentarités des IA quantiques et fortes, mieux vaut commencer par délimiter la notion d’intelligence humaine. S’il fallait en donner une définition, nous pourrions par exemple dire qu’il s’agit d’un ensemble d’aptitudes cognitives permettant aux humains d’apprendre, comprendre, communiquer, penser et agir de manière pertinente, rationnelle, logique ou émotionnelle, en fonction de la situation dans laquelle ils se trouvent.

On peut alors se demander de quoi l’intelligence humaine est constituée. Plusieurs modèles de l’intelligence existent, comme la théorie de Cattell–Horn–Carroll (CHC) [1]. Bien qu’il n’y ait pas encore de consensus absolu sur la question, les aptitudes cognitives propres à l’intelligence humaine pourraient se ranger en grandes catégories (quelque peu ré-agrégées ici) telles que :

- L’intelligence logique et quantitative : capacité d’abstraction et de formalisation, rationalité et raisonnement ;

- L’intelligence littéraire et philosophique : langage, lecture, écriture, structuration de la pensée et des idées ;

- L’intelligence sociale et émotionnelle : introspection, capacité à interagir avec autrui, capacité à comprendre, percevoir, ressentir et manifester les émotions ;

- L’intelligence réactive et psychomotrice : attention, coordination, traitement parallélisé de stimuli multiples, endurance mentale ;

- Intelligence perceptive et artistique : représentations visuelle, auditive, spatiale, temporelle, kinesthésique… ;

- L’intelligence mémorielle : sollicitation de la mémoire à court, moyen ou long terme en fonction des tâches.

Evidemment, ces déclinaisons de l’intelligence ont des recouvrements et peuvent être réorganisées différemment. Par ailleurs, certaines sont corrélées de manière subtile, en particulier avec la mémoire. C’est pourquoi les modèles théoriques ont tendance à distinguer des intelligences dites “fluides” de celles dites “cristallisées” pour différencier les traitements requérant ou non de l’apprentissage et de la connaissance présente durablement en mémoire. On y retrouve une froide analogie avec les ordinateurs qui peuvent utiliser l’information stockée en permanence sur les disques durs ou celle, plus rapide d’accès, présente temporairement en RAM (mémoire vive), voire en cache.

Mais surtout, des scientifiques comme Spearman (le père du coefficient de corrélation éponyme) ont longtemps voulu démontrer l’existence d’un “facteur g” [2] qui consoliderait toutes ces aptitudes en une seule forme d’intelligence générale. Cependant, à ce jour, aucun modèle ne fait réellement consensus.

Du coup, comment définir l’intelligence artificielle ?

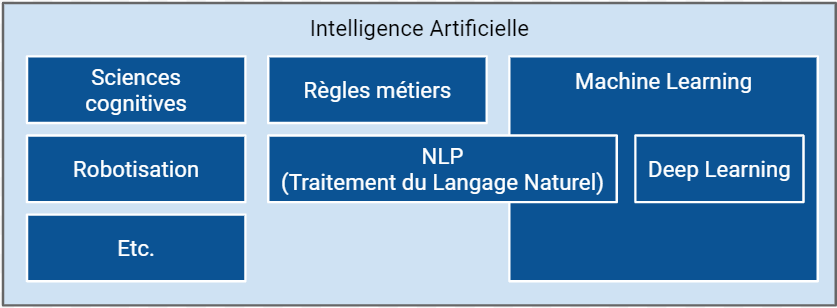

De son côté, l’intelligence artificielle est un ensemble de sciences et techniques visant à concevoir des machines autonomes dotées de capacité d’apprentissage et de raisonnement analogues à celles des humains. Attention, il s’agit bien d’une analogie de l’intelligence humaine plutôt que d’un vulgaire clonage technique. Parmi les sciences sous-jacentes de l’IA, on trouve notamment l’apprentissage automatique (Machine Learning) – au sein duquel se trouve l’apprentissage profond (deep learning), caractéristique de l’avènement de l’IA depuis 2012 -, puis les techniques de traitement du langage naturel, les neurosciences, la robotisation informatique, etc.

Néanmoins, le terme IA revêt des définitions bien différentes en fonction des secteurs d’activité. A ce sujet, je vous invite à consulter ces articles qui expliquent la différence entre les IA du type Machine Learning et les IA dans les jeux vidéos.

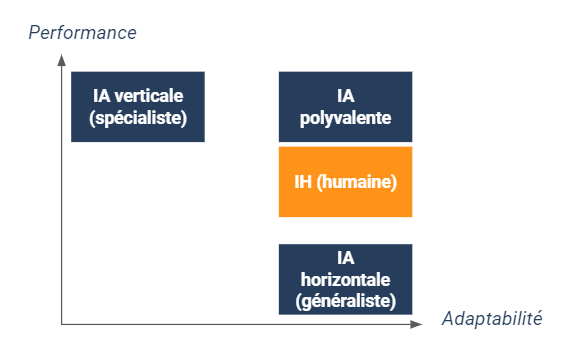

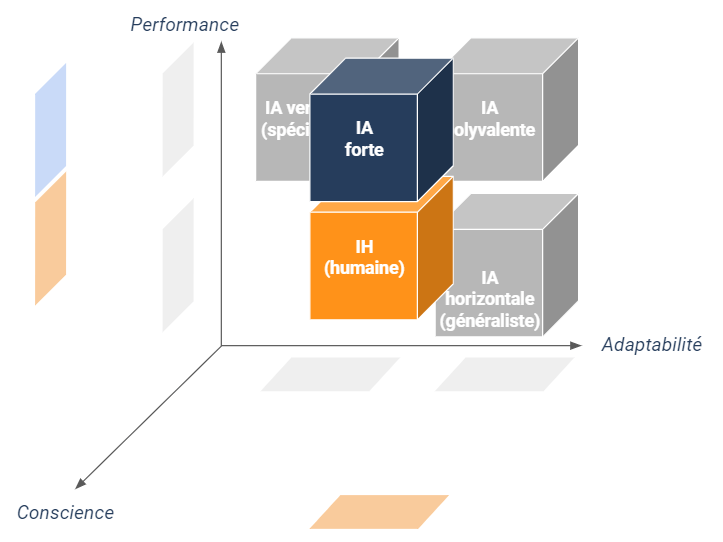

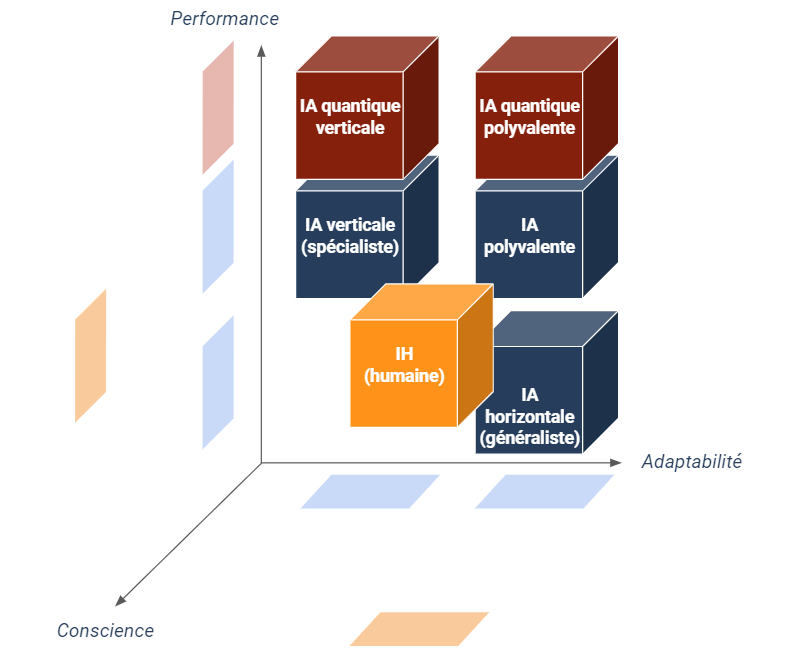

Dans le monde de l’entreprise, les algorithmes de Machine Learning (voire Deep Learning) ont permis de créer des programmes extrêmement performants – en termes de précision et de vitesse – dans certains types de traitements. C’est ainsi que trois types d’IA (on pourrait plutôt parler d’algorithme ici) ont émergé :

- Verticale ou spécialiste : ultra-performante dans l’exécution d’une tâche mais très peu adaptable à des tâches différentes ;

- Horizontale ou généraliste : raisonnablement performante dans l’exécution d’une tâche mais surtout adaptable à des tâches différentes (par des mécanismes de transfer learning par exemple) ;

- Polyvalente : supérieure à l’humain dans l’exécution de plusieurs tâches et adaptable.

Aujourd’hui, on a réussi à implémenter des IA verticales très performantes (par exemple le diagnostic médical sur la base de radiographies) et dans une certaine mesure des IA horizontales dans le domaine de la vision, du langage et des jeux. Mais on a encore beaucoup de mal à concevoir de bonnes IA généralistes (a fortiori des IA polyvalentes). Il suffit de regarder les IA qui pilotent les véhicules autonomes : on a du mal à imaginer ces IA faire des analyses boursières pour piloter des investissements en entreprise, alors que nos financiers humains n’ont généralement aucun problème pour conduire une voiture par ailleurs !

De plus, ce qu’il est important de retenir, c’est que toutes ces IA sont dites “faibles” (y compris les IA polyvalentes) car elles ont beau être supérieures à l’humain dans la réalisation de certaines tâches bien ciblées, il leur manque des aptitudes inhérentes à ce dernier comme :

- la conscience de soi et la capacité à faire preuve d’introspection ;

- la capacité à prendre des décisions non apprises ou à ressentir des émotions non programmées (à supposer qu’elles soient déjà programmables) ;

- la motivation, la curiosité et la quête de sens dans son existence.

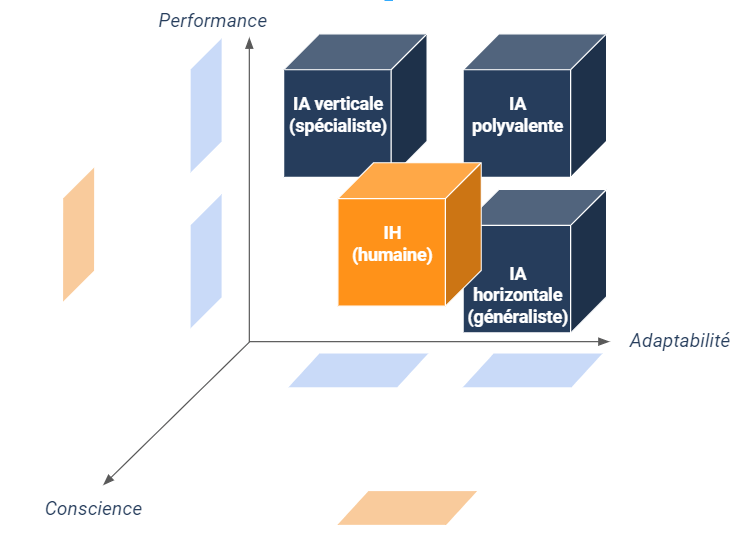

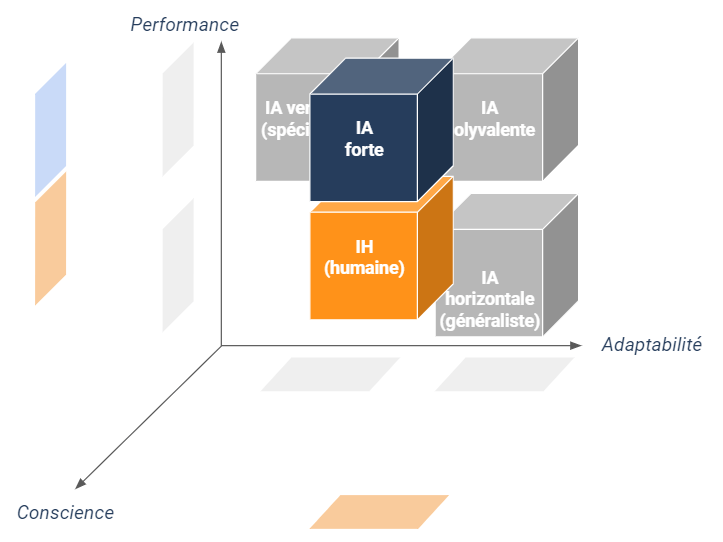

Une IA qui acquerrait de telles aptitudes humaines serait qualifiée d’Intelligence Générale Artificielle (désignée par le sigle anglais AGI) ou plus simplement “IA forte” voire “IA complète”.

Une définition de l’IA forte

Ainsi, on pourrait définir les IA fortes comme des IA polyvalentes douées de conscience, capables de ressentir, désirer, juger et décider en parfaite autonomie. Arrivées à un tel niveau de sophistication, ces IA fortes pourraient être par exemple en mesure de mettre à jour le code qui les a conçues pour s’adapter à leur environnement ou à leurs nouvelles aspirations.

Beaucoup craignent cette IA forte – à commencer par Elon Musk [3] dont les envolées lyriques et alarmistes ont fait le tour des réseaux sociaux à maintes reprises. Pourquoi ? Parce que si une telle IA cherchait à s’émanciper ou venait à “partir en vrille”, comme potentiellement n’importe quel humain dans une situation extrême, alors elle pourrait avoir des conséquences désastreuses de par ses capacités d’exécution démesurément plus importantes que celles du cerveau humain et surtout non restreintes par l’imperfection de notre corps physique et limitant. Ce jour où l’IA échapperait définitivement au contrôle des hommes semble digne de la plupart des romans ou films dystopiques tels que Matrix, Terminator, Transcendance ou I, Robot. Mais cette singularité est-elle seulement possible ? Difficile de donner une date pour la naissance d’une IA forte dans la mesure où les obstacles qui se dressent devant la conception de celle-ci sont multiples et peut-être irrésolvables.

L’IA forte face à la conception matérialiste de la pensée

Tout d’abord, il faudrait pouvoir déterminer si l’intelligence humaine – telle que précédemment définie -, les émotions et les perceptions sensorielles sont réductibles à un fonctionnement purement matériel constitué de composants électroniques. Cette problématique est effectivement loin d’être évidente, même pour les plus agnostiques d’entre nous. Qui n’a jamais été fasciné par la capacité qu’a notre organisme à produire des réminiscences insoupçonnables par la simple perception d’une odeur ou d’une musique, souvent rattachée à un souvenir fortement chargé en affect ? Est-il du coup possible de reconstruire un tel processus psychique et sensoriel avec un ensemble de transistors et de portes logiques calculatoires et déterministes ?

Même sans avoir tous les éléments de démonstration, il peut être tentant de répondre par la négative car la biophysique neurale diffère par nature des circuits électroniques des ordinateurs. Mais pour pouvoir répondre plus en détails, il faudrait que l’on comprenne parfaitement la mécanique générale du cerveau. De là émerge une nouvelle question : aussi surprenantes que soient les dernières découvertes scientifiques en neurosciences, le cerveau humain a-t-il seulement à sa disposition tous les éléments d’intelligence pour comprendre avec certitude son propre fonctionnement ? Les mathématiciens verront certainement ici une référence au théorème d’incomplétude de Gödel [4].

Plus concrètement – n’étant pas à l’aise avec l’application de ce théorème au fonctionnement de l’esprit -, je m’interroge ici sur les limites physiques du cerveau qui nous empêcheraient de comprendre les éléments nécessaires à sa propre compréhension. Par exemple, si l’on essaye d’imaginer une autre couleur perceptible par l’oeil humain (non présente dans le spectre visible), un autre état de la matière (différent de solide, liquide, gaz ou plasma), ou encore la représentation mentale d’une quatrième dimension spatiale, on se rend vite compte que l’on n’en est pas capable. Ce qui ne veut pas dire pour autant que ces objets inaccessibles à notre esprit n’existent pas, mais plutôt que notre cerveau n’est pas en mesure d’imaginer des perceptions étrangères à sa propre structure physique. C’est d’ailleurs tout le problème des qualia (sensations subjectives provoquées par la perception de quelque chose) et de leurs liens avec la conscience. On en vient naturellement à se demander si le cerveau n’est pas le siège de phénomènes autres que l’électricité neurale et la biochimie des synapses…

Le recours à l’IA quantique pour approcher la conscience artificielle

Même sans prendre en compte ces considérations métaphysiques, on sent bien qu’une machine de Turing – modèle calculatoire sur lequel reposent les algorithmes traditionnels -, bien qu’en mesure de simuler beaucoup de choses, ne sera peut-être intrinsèquement jamais apte à ressentir, percevoir et raisonner comme un humain. C’est pourquoi, pour contourner la barrière du déterminisme et de la perception de la réalité, afin de réaliser une conscience artificielle, certains seraient tentés de faire appel à deux récents pans de la recherche fondamentale.

Le premier, que je ne détaillerai pas ici, est celui de ce qu’on pourrait appeler les réseaux de neurones hybrides (artificiels et biologiques !) qui combinent donc des circuits électroniques et des cellules vivantes en laboratoire, à l’instar de la société Koniku [5] ;

Le second est bien entendu l’informatique quantique dont la particularité fondamentale est d’exploiter les propriétés des particules pour réaliser des opérations intrinsèquement parallélisées dont les résultats ne sont plus déterministes mais probabilistes.

Pourquoi ce choix ? Car certains scientifiques tels que Penrose et Hameroff [6] ont émis comme hypothèse que des phénomènes quantiques (superposition et intrication) siègeraient dans notre cerveau via les spins (aimantation intrinsèque) des protéines présentes dans les microtubules neuronaux qui se comporteraient comme les qubits d’un ordinateur quantique. Pour plus de détails sur ces phénomènes, je vous renvoie au deuxième article de l’IA quantique.

Digression technique

Il peut en effet sembler naturel de faire appel au formalisme de Dirac (à la base de l’algèbre modélisant la mécaniques quantique) et aux qubits pour décrire l’évolution de ces micro-systèmes cérébraux. Il y a par exemple une volonté similaire dans le domaine de l’atomistique pour décrire avec précision les orbitales moléculaires. Cela revient à utiliser l’informatique quantique pour simuler la physique quantique. C’est un peu comme recourir à l’informatique traditionnelle pour simuler l’électronique des processeurs.

Néanmoins, l’accueil réservé à cette théorie fut fort mitigé, pour la simple et bonne raison qu’en dehors des photons (constituants de la lumière), il n’y a presque aucun système physique à température ambiante capable de faire durer les phénomènes quantiques suffisamment longtemps (on parle de temps de décohérence, généralement bien inférieur au milliardième de milliseconde pour les agrégats moléculaires naturels) pour que ceux-ci ait un quelconque impact sur le fonctionnement neuronal.

Donc même si l’informatique quantique permettait aux IA verticales de résoudre des problèmes insolubles aujourd’hui, elle ne semblerait pas capable d’ajouter de nouvelles propriétés jusqu’alors attribuables au seul cerveau biologique dont les capacités quantiques sont elles-mêmes discutables. Autrement dit, pour reprendre les schémas précédents, la quantique ne peut selon moi faire progresser l’IA que selon l’axe de la performance mais pas selon les axes de l’adaptabilité aux tâches diverses ni, a priori, à la conscience. Quantiques ou pas, les perspectives de la pensée artificielle semblent toujours bien lointaines.

Digression technique

J’ai cependant encore une réserve favorable sur le fait que la quantique puisse un jour permettre de modéliser des mécanismes tels que la notion de réalité subjective ou de conscience. En effet, certains phénomènes comme la contrafactualité quantique (cf. l’interféromètre de Mach-Zehnder ou le testeur de bombes d’Elitzur-Vaidman [7]) n’auraient jamais pu être compris sans la mécanique quantique.

Pour être bref, celle-ci décrit le fait qu’une particule “teste” tous les chemins qui lui sont possibles (sans les emprunter réellement, on parle ici de son onde de probabilité associée) avant d’en réellement “choisir” un avec une probabilité donnée. Autrement dit, un phénomène qui pourrait avoir lieu sur l’un des chemins d’une particule, qu’il se réalise ou non, trahit toujours sa potentielle survenue en interférant probabilistiquement le résultat d’autres mesures sur d’autres chemins possibles. C’est comme si tous les futurs possibles d’une action interféraient entre eux et que seul le futur avec les meilleures probabilités résultantes émergeait du présent lors de l’effondrement des fonctions d’onde.

Ce phénomène surprenant témoigne du fait que nous n’ayons pas trouvé mieux que la quantique pour décrire avec justesse certaines expériences microscopiques qui défient l’intuition, et que même si la réalité est toute autre, la quantique apparaît comme le meilleur outil pour décrire ce que l’on observe. J’en réfère ici au courant de pensée de l’école de Copenhague [8]. Je me dis qu’il en est peut-être de même avec la conscience que seule une théorie aussi abstraite que la mécanique quantique pourrait décrire. En tout cas, s’il existait vraiment une telle opportunité de modélisation de processus physiques subtils avec un formalisme du type quantique (qui est un outil avant tout), alors la naissance d’une IA forte serait effectivement remise en jeu. Mais en l’état actuel des choses, la mécanique quantique ne semble pas nous aider sur le chemin de la conscience dont le caractère quantique est lui-même incertain.

Et si l’IA forte existait sur le plan théorique, serait-il possible de la créer pour de vrai ?

Mais admettons que ce soit possible, que l’on puisse créer une IA forte.. Est-il empiriquement possible de bénéficier des talents et de l’énergie nécessaires pour construire cette IA avant la fin de l’humanité ? La question se pose effectivement. Si on laisse de côté la complexité conceptuelle d’un tel programme / algorithme, on peut regarder deux métriques importantes : le temps et l’énergie.

Concernant le temps, il s’agit de surtout de connaître l’horizon à partir duquel on aura une connaissance plus robuste des mécanismes de la conscience et le temps que prendra la conception physique d’un esprit artificiel, à supposer que l’humanité n’ait pas de problématiques vitales à régler en priorité d’ici là. Quant à l’énergie, IBM donne quelques ordres de grandeur de la consommation des supercalculateurs : il faudrait pas moins de 12 gigawatts [9] pour séquencer un unique ordinateur comportant autant de neurones artificiels que le cerveau humain (environ 80 milliards). Cela équivaut grossièrement à la puissance délivrée par une quinzaine de réacteurs nucléaires français (un quart du parc !). De ce point de vue là, l’homme, avec ses 20 watts de puissance dépensée, est incroyablement plus économe… Et n’espérez pas vous rabattre sur la quantique pour optimiser l’énergie. Pour préserver la cohérence des superpositions / intrications des qubits (nécessaires à une accélération du temps de traitement algorithmique), il faut abaisser la température des ordinateurs au voisinage du zéro absolu (-273,15° C). L’énergie requise est évidemment colossale.

Du coup, si on part du principe que la création d’une conscience artificielle requerra autant voire plus d’énergie que ces super-calculateurs – quantiques ou non -, il semble impensable que nous consacrions autant de ressources à l’élaboration d’une telle IA, fût-elle forte. Et même si on s’y aventurait, on aurait créé un cerveau conscient artificiel semblable à un froid datacenter, mais en aucun cas cela s’apparenterait à un humanoïde se promenant dans la rue (dans le cas contraire, je vous laisse imaginer la taille de la batterie alimentant le cerveau d’un tel cyborg). Même si la recherche actuelle s’évertue à rendre les réseaux de neurones plus économes, on sera probablement confronté à une impasse industrielle lorsqu’il s’agira de rendre les IA fortes et mobiles, à supposer que cela ait un intérêt anthropologique.

En synthèse, du fait de notre méconnaissance des mécanismes de la conscience, l’IA quantique ne sera probablement pas plus une “IA forte” que les IA classiques. La question de l’utilité d’une IA forte peut se poser, mais il est fort à parier que nous mettions davantage d’efforts à rendre les IA verticales plus légères et moins énergivores, surtout lorsque ces dernières seront partiellement quantiques.

____

Cet article fait partie d’une chronique dédiée à l’IA quantique. Retrouvez tous les posts du même thème :

Partie 1 – En finir avec l’impuissance !

Partie 2 – Faites vos jeux !

A. Augey

Publication relayée sur le blog de Saagie : https://www.saagie.com/fr/blog/lia-quantique-partie-3-le-soulevement-des-ia/

Publication relayée sur le blog de Saagie : https://www.saagie.com/fr/blog/lia-quantique-partie-3-le-soulevement-des-ia/